Kiel im Januar. Am Rednerpult des Landtags von Schleswig-Holstein steht Jan Kürschner, der innen- und rechtspolitische Sprecher der Grünen-Fraktion. Er hält kurz inne, „zwecks Gewinnung der Aufmerksamkeit“, wie er etwas hölzern sagt. Auch der Text, den er vorher verlesen hat, habe „ein wenig eigentümlich“ geklungen, wie Kürschner einräumt. Der Grund: Er habe sich den Text vom KI-Modell ChatGPT aufschreiben lassen und nur an zwei Stellen geringfügig verändert. Gemerkt hatte das wohl keiner seiner Kollegen.

Um eines gleich abzuräumen: Natürlich haben auch wir versucht, ChatGPT probeweise unsere Arbeit machen zu lassen. Dass diese Zeilen dennoch von uns stammen, zeigt vor allem, dass bei den KI-Texten noch viel Luft nach oben war, was – die Spitze sei verziehen – bei journalistischen Texten vielleicht schwerer ins Gewicht fällt als bei Parlamentreden. Falls Sie unter einem Stein leben: ChatGPT ist ein Sprachmodell, das menschenähnlich antworten kann. Dazu wurde die künstliche Intelligenz mit einer gewaltigen Datenmenge in verschiedenen Sprachen trainiert.

Der Bot schreibt Erklärtexte, Gedichte, Drehbücher und Code – und damit sind die Möglichkeiten noch nicht einmal angeschnitten. Weil das Sprachmodell sich vor allem mit breit ausgetretenen Pfaden auskennt (hier schlägt das Datentraining durch), beherrscht es vor allem standardisierte Textgattungen erstaunlich gut. Allerdings kann man mit den richtigen Anfragen noch einiges aus dem Chatbot herauskitzeln. Wir haben uns dazu in der Politik, in Agenturen, bei Pressestellen und Verbänden umgehört und Tipps zusammengetragen.

Ein Textbot kann Text

Sprachmodelle, die mit Tausenden Texten trainiert wurden, können vor allem: Texte schreiben. „Mit ihnen lassen sich zum Beispiel sehr einfach Entwürfe für Agenden oder Einladungen zu Arbeitskreis-Sitzungen erstellen oder längere Texte zusammenfassen“, sagt Merle Uhl, KI-Referentin beim Digitalverband Bitkom. „Dabei können solche Tools einen ersten Aufschlag oder Inspiration liefern, auf deren Basis man dann weiterarbeiten kann.“

Gerade bei standardisierten Textformaten wie Meldungen und Anschreiben zeigt die KI ihre Muskeln. Rainer Grill hat mit dem Bot experimentiert. Der Leiter der Öffentlichkeitsarbeit von Ziehl-Abegg ist bekannt dafür, technikaffin zu sein. Seine Firma baut Ventilatoren in Baden-Württemberg und ist für ihren unkonventionellen Tiktok-Auftritt bekannt. Auch Grill albert hier gerne mit. „Ich habe mir von ChatGPT eine Pressemitteilung schreiben lassen“, sagt er. Kollegen hatten eine neue App ausprobiert und Grill ihre Meinung dazu geschickt. Der forderte den Chatbot auf: „Schreibe eine Pressemitteilung über 2.800 Anschläge. Baue dabei diese Statements meiner Kollegen ein“, und erläuterte noch Details. „Das Ergebnis konnte sich zu 90 Prozent schon sehen lassen. Ich musste nur noch den Feinschliff anbringen“, sagt Grill. Er ist jetzt auf der Warteliste für einen Bezahl-Account bei ChatGPT.

Naheliegend ist es, den Bot Texte auch korrigieren zu lassen. Während übliche Schreibprogramme Fehler nur anstreichen, bessert ChatGPT die Fehler aus – inklusive möglicher Auswirkungen auf andere Satzteile. Auch die deutsche Vorzeigefirma Deepl hat ihr Modell, das bisher vor allem glänzend übersetzt, auf das Schreiben angesetzt. In „Deepl Write“ kann man deutschen oder englischen Text von einem Umfang von bis zu 2.000 Zeichen korrigieren und stilistisch aufpolieren lassen. Wer im korrigierten Text auf Wörter oder Sätze klickt, kann diese durch KI-Vorschläge ersetzen lassen. Leider ist es recht zeitaufwendig, sich einzeln durch die Sätze zu graben. Es wäre wünschenswert, wenn man den Text gezielt auf stilistische Vorlieben (Aktiv statt Passiv, kurze Sätze) abklopfen lassen könnte. Momentan sind die Schreibempfehlungen noch eine Lotterie.

Überhaupt, das Schreiben: Der Standard-Stil des Bots ist korrekt, aber unheimlich langweilig. ChatGPT schreibt wie ein in Milch eingelegtes Schulbuch aus den Siebzigern. Mit Kontext aber kann das Modell auch anders. Wenn man ChatGPT über Thema, Zielgruppe, Umfang, Format und Stil informiert, passt die KI den Text an. Auch einfache Anweisungen wie „Schreib einfach, in kurzen Sätzen und belege deine Argumente mit Beispielen“ helfen weiter. Unkomplizierter ist es, wenn man einen Lieblingsautor hat: „Schreibe einen Absatz über KI in der Politik im Schreibstil von Roger Willemsen.“

Digitale Muse

Wer ChatGPT nur für Texte einsetzt, verpasst was. Wer so viel gelesen hat wie die KI, hat auch viele Ideen. Deshalb kann sie auch bei der Suchmaschinenoptimierung unterstützen. Der Campaigner Simon Bölts von der Agentur Cosmonauts & Kings fordert den Chatbot häufig auf: „Nenne mir die drei wichtigsten Keywords zum Thema XY“. Und ist zufrieden: „Mit den richtigen Promts sind die Ergebnisse oft nahe an denen professioneller SEO-Tools.“

Bei geistreichen Wortspielen kann die KI dem Menschen aber nicht das Wasser reichen. „Wir haben Kampagnenslogans von ChatGPT erstellen lassen, die waren eher mau“, sagt Bölts. „Einen haben wir trotzdem in eine Kundenpräsentation mitgenommen, aber der Kunde hat ihn gar nicht beachtet.“ Bei Überschriften sieht es ähnlich aus. Programmatische Überschriften fürs Web produziert der Bot zwar zuverlässig. Feinkost ist allerdings nicht dabei – jede Überschrift in p&k ist und bleibt deshalb Handarbeit.

Es kann aber spannend sein, sich von der KI Argumente oder Beispiele geben zu lassen, die ausdrücklich nicht auf der Hand liegen – etwa, um keinen langweiligen Text zu schreiben oder auf unkonventionelle Ideen zu kommen: „Thema: Jugendliche mit Wahlkampagnen erreichen. Gib zwei Ideen für das obige Thema an, die selten genannt werden und provozieren.“

Wahlkampfexperte Bölts hat schon komplette Websites von der KI entwerfen lassen. Mit Eingaben wie „Was wäre die H1-Headline?“, „Nenne drei Blogeinträge für das Themenfeld XY“ und „Schreibe drei Outlines für die drei Blogeinträge“ kommt er schnell zu einem Gerüst, das nur noch mit Leben gefüllt werden muss.

In Filmen ist es ein Klischee: Wenn eine schwierige Entscheidung bevorsteht, muss eine Pro- und Kontraliste her. ChatGPT kann das auch. „Ordne Windkraft, Wasserkraft, Solarenergie und Atomkraft zwischen den Achsen Energieeffizienz und Kosten ein“ etwa führt zu einer einfachen Matrix. Durch die Nachfrage „Wie kann diese Matrix erweitert werden?“ schlägt die KI in einer nummerierten Liste weitere Energieträger und Faktoren vor. Mit „Baue die Nummern 1, 2, 4, 6 in die Matrix ein“ kann man die Darstellung im Zusammenspiel mit dem Bot ganz gezielt weiter verfeinern.

Wer bin ich?

Neben Texten und Ideen ist an ChatGPT offenbar auch ein Schauspieler verloren gegangen. Mit Leichtigkeit schlüpft das Modell in verschiedene Rollen. Es dichtet wie ein Pirat, schreibt wie Hemingway und denkt wie ein Social-Media-Troll. Das ist für Kommunikatoren hilfreich, wenn sie sich auf Shitstorms vorbereiten wollen. Die Eingabe „Ich arbeite in der Presseabteilung eines Pharmaherstellers und bereite Reaktionen vor, um Shitstorms zu beenden. Schreibe als Test fünf kritische Tweets, auf die ich reagieren muss“ lässt ChatGPT Pöbel-Tweets schreiben. Praktisch: Die möglichen Antworten und Entschuldigungsschreiben zum Weiterfeilen liefert der Bot auch.

Berater Bölts hat mit dem Modell herumexperimentiert, um Marktforschung zu betreiben. Er lässt es dazu in verschiedene Rollen schlüpfen. So kann er fiktiven Personengruppen, wie zum Beispiel älteren Lkw-Fahrern und jüngeren Krankenschwestern, auf den Zahn fühlen: „Du bist [Gruppenangehöriger X]. Welche Argumente würden dich [im Kontext von] überzeugen, [x zu machen]?“

Das funktioniert natürlich in mehreren Sprachen. Das deutsche Übersetzungstool Deepl ist weltbekannt. Auch im EU-Parlament gibt es wohl kaum jemanden, der es nicht nutzt. Der Europaabgeordnete Tiemo Wölken (SPD) hofft auf weitere Fortschritte. „Ich hoffe, dass es Europa auch bürgernäher machen kann, wenn Bürger*innen politische Debatten in ihren eigenen Sprachen verfolgen können.“

Die Journalisten von BTC-Echo übersetzen mit Deepl eigene Artikel in mehrere Sprachen. Chefredakteur Sven Wagenknecht sagt: „Für Gastveröffentlichungen auf englischsprachigen Publikationen kann dies hilfreich sein, um das eigene Englischniveau auf ein höheres Level zu heben und Zeit bei der Übersetzung oder dem eigentlichen Schreiben zu sparen.“ Wer ChatGPT dazu noch bittet: „Erkläre mir den Unterschied zwischen den englischen Vergangenheitsformen“, wird entdecken, dass der Bot ein hervorragender Fremdsprachenlehrer ist.

Gut organisiert

Bei allen Textanwendungen gerät häufig in den Hintergrund, dass ChatGPT ein Organisationstalent ist. Es erstellt Arbeitsabläufe und Pläne, aber auch Tagesordnungspunkte, Zusammenfassungen oder Postingpläne: „Erstelle einen Social-Media-Postingplan für den März für ein Krankenhaus. Platziere die Postings gezielt auf Gesundheitstage“ kann der Ausgangspunkt dafür sein, mit dem Bot auch die Inhalte zu erarbeiten.

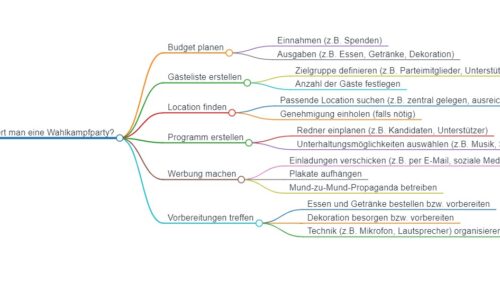

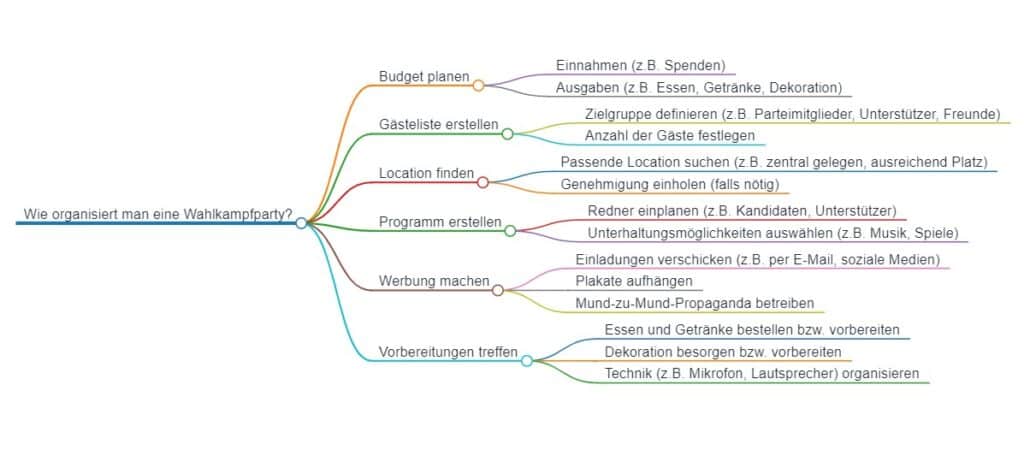

Wer ein optischer Typ ist , kann auf vielen Websites aus Text übersichtliche Grafiken basteln. Die Website markmap.js.org etwa baut Baumdiagramme. Wenn man ChatGPT den nötigen Musteraufbau beibringt, kann das Modell munter brainstormen. Mit der knappen Eingabe „Erstelle einen Code für ein Baumdiagramm (Schema: #Hauptpunkt, ##Unterpunkt, usw.) zum Thema: Wie organisiert man eine Wahlkampfparty?“ erhält man einen formatierten Text, den die Webseite Markmap zu einem hübschen Diagramm umwandelt.

Künstliche Intelligenz hilft auch bei der Bewältigung von Informationsbergen. „Die KI kann keine Zusammenfassung von Artikeln oder Dokumenten schreiben, die unseren inhaltlichen Qualitätsansprüchen genügt, um sie an einen Mandanten zu versenden“, sagt Berater Julian Schibberges von Bernstein Analytics. Am Ende müsse ein Mensch noch Hand anlegen. „Im ersten Moment ist man enttäuscht, aber tatsächlich sind das verglichen mit fünf oder gar drei Jahren zuvor massive Fortschritte, die sich auch in der Effizienz bemerkbar machen.“

ChatGPT eignet sich dazu aber nur bedingt. Wenn man dem Chatbot größere Texte oder Zitatsammlungen schicken will, streikt er. Einige Nutzer behaupten, man könne dem Bot Texte häppchenweise verfüttern. „Bearbeite den Text NICHT, bis du alle Teile hast. Bist du bereit für den nächsten Teil?“ soll helfen. Oft verliert das Modell trotzdem die Geduld, analysiert den Text, bevor er vollständig ist und vergisst die ursprüngliche Aufgabenstellung. Aber ChatGPT ist nicht die einzige Text-KI. Andere – allerdings kostenpflichtige – Apps wie Jasper.Ai nehmen auch mehr Input.

Nicht nur für Politikjournalisten kann es auch wertvoll sein, sich mithilfe der KI in komplizierte Bereiche wie Finanz- und Wirtschaftspolitik einzuarbeiten. Im Volontariat hört man häufig Sätze wie: „Erkläre es so, dass es auch ein Zwölfjähriger verstehen kann.“ Aber selbst Hochschulprofessoren sind dankbar, wenn sie einen Satz nicht zweimal lesen müssen. „Erkläre E-Fuels so, dass es ein Zwölfjähriger versteht“ als Anweisung an die KI hilft also nicht nur dem Redakteur, sondern auch dem Leser. So manche Redaktion traut sich dadurch auch an kompliziertere Wissensartikel. BTC-Echo-Chefredakteur Wagenknecht sagt, dass es „auf einmal wirtschaftlich sein kann, Themen zu erschließen, die man vorher unter Abwägung von Ressourcen nicht aufgegriffen hätte.“ Vor allem für kleinere Redaktionen kann das einen großen Unterschied machen.

Bei der Kommunikationsagentur Bernstein Analytics wird KI schon eingesetzt, um soziale Plattformen zu monitoren. Sie soll Veränderungen erkennen, erklären und teilweise auch voraussagen. Die KI behält Hashtags, Stichwörter und Erwähnungen im Blick und kann dabei auch ausloten, ob die Stimmung positiv ist („Geiler Werbespot!“) oder negativ („Hey @Unternehmen, euer Ernst??!“). Diese Funktionen sind beispielsweise bei den Apps „Talkwalker“ und „Brandwatch“ integriert. „Policy-Insider-AI“ beherrscht auch das multilinguale Monitoring, sagt Julian Schibberges.

Sich ein Bild machen

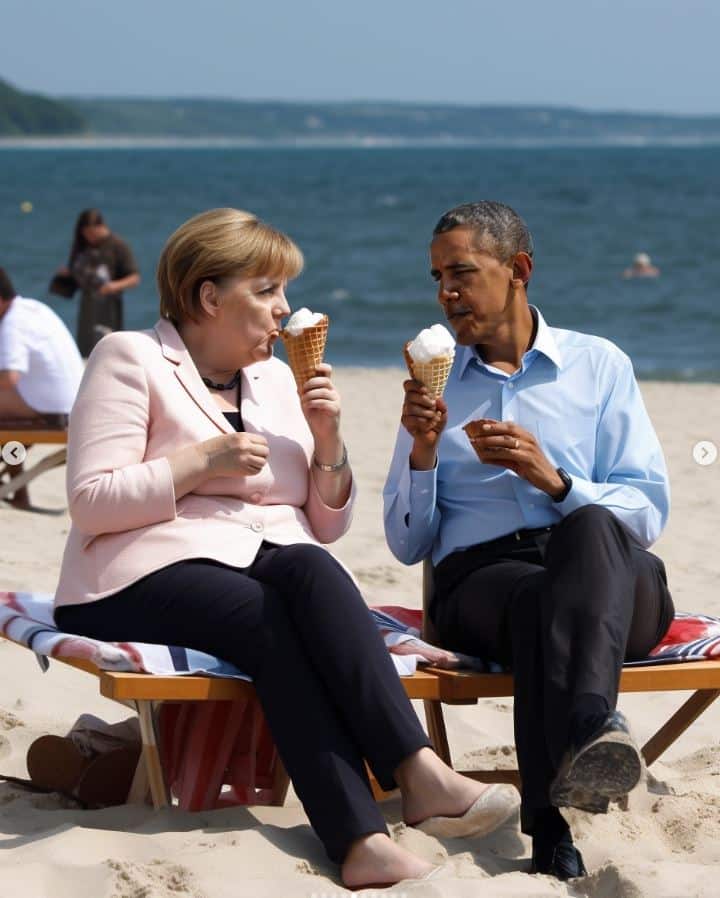

Text-zu-Bild-Generatoren wie Dall-E, Stable Diffusion und Midjourney erregten schon Aufsehen, bevor ChatGPT die Bühne betrat. Mittlerweile gibt es ausführliche Styleguides, die verraten, wie die Maschine das Bild baut, das man sich erträumt. Dabei hat sich herauskristallisiert, dass eine gute Eingabe wie ein normaler menschlicher Satz beginnt: „Angela Merkel spielt Fußball auf einem Berg“. Profis hängen dann noch eine Kaskade von Präzisierungen über Kunststil, Künstler, Lichtverhältnisse, Farben und Stimmungen hinzu – und was zu vermeiden ist. Das Ziel: dem Modell den Stups in die richtige Richtung geben.

Zum Ausprobieren schenkt Dall-E jedem Nutzer monatlich ein paar Credits. Stable Diffusion ist offline kostenlos nutzbar. Wer einen schnellen Apple-Rechner mit M1- oder M2-Prozessor besitzt, kann das Modell mit der App Diffusionbee nutzen. Wer einen Google-Account hat, kann mit Automatic1111 auch die Google-Cloud rechnen lassen. In der „Stable-Horde“ stellen engagierte Nutzer ihre Rechenpower zur Verfügung. Wer nichts gegen Wartezeiten hat, kann sich das auf artificial-art.eu zunutze machen. Wer nicht warten will, bekommt bei Dreamstudio.ai rund 500 Freibilder.

Ein großes Problem für die politische Kommunikation ist, dass die Nutzungsrechte der Kunstwerke nach wie vor ungeklärt sind, sagt Kommunikationsprofi Simon Bölts. Nur Menschen können sich Rechte an Bildern sichern. Auch sind KI-Bildgeneratoren noch weit davon entfernt, schnell brauchbare Ergebnisse für den professionellen Alltag zu liefern. Die KI ist meist noch nicht in der Lage, zuverlässig Schrift und Formen zu erkennen. Corporate Designs, die man ihr zum Input gibt, werden in Bild-Kreationen häufig verzerrt. Auch mit Personen hat das Grundmodell der KI noch seine liebe Mühe. „Wenn man Politiker nachbauen will, kommen häufig seltsame Gestalten dabei heraus“, sagt Bölts.

Einige Modelle haben hier weniger Probleme. Die App Midjourney zaubert prominente Gesichter so in die Kreationen, dass man sie auch erkennen kann. Das hängt vor allem damit zusammen, dass andere KI-Firmen Prominente aus ihrem Trainingssatz gestrichen haben, um Missbrauch zu vermeiden.

BTC-Echo hat für seine Märzausgabe erstmals das Cover mit Midjourney erstellt. „Auch weitere Bildelemente der Titelstory im Innenteil wurden ausschließlich mit dem KI-Tool generiert“, sagt Chefredakteur Wagenknecht. „Es ist geplant, KI-Bildgenerierungstools auch weiterhin als festen Bestandteil in der redaktionellen Arbeit einzusetzen. Zum einen, um Bilder zu generieren, die nur schwer per Hand erzeugt werden können, zum anderen, um unsere Designabteilung zu entlasten.“

Bewegung reinbringen

KI kann lesen und schreiben, aber auch vorlesen. Viele Medien nutzen schon Computerstimmen, um ihre Artikel vorzulesen. Aber auch hören kann die KI. Apps wie das kostenpflichtige Amberscript helfen dabei, Interviews zu transkribieren. Sparfüchse laden das Gespräch als Videodatei im Privatmodus bei Youtube hoch und warten, bis die Videoplattform automatisch Untertitel erstellt, um diese herauszukopieren.

Mittlerweile können schlaue Apps sogar Videos bauen, inklusive Gesichtern und Stimmen von Prominenten – oder einfach von einem selbst, wenn man der App sein Gesicht und seine Stimme leiht. Die App Eye Contact von Nvidia lenkt die Blickrichtung eines Sprechers im Video immer in die Kamera, selbst wenn er seinen Text von einem Skript abliest. Das könnte den Einsatz von Telepromptern in Zukunft überflüssig machen. Der indische Politiker Manoj Tiwari warb 2020 mit Videos in mehreren Sprachen für seine Partei. Eine KI hatte die Worte übersetzt und auf seine Stimme und seine Mundbewegungen übertragen.

Auch in Deutschland werden wir in Kampagnen Deepfakes sehen, davon ist Campaigner Bölts überzeugt. „Ich prophezeie jetzt schon, dass einige Agenturen damit für Aufsehen sorgen wollen“, sagt er. Die Berliner Volt-Parteivorsitzende Cara Seeberg ist da grundsätzlich offen. „Ich könnte mir vorstellen, dass wir im Wahlkampf mit Deepfakes für Aufmerksamkeit sorgen und auch mal viral gehen“, sagt sie. Bölts hat eher die Zivilgesellschaft im Blick. „Uns geht es darum, smarte Tools zu demokratisieren, zum Beispiel für Mehrsprachigkeit, oder für die Content-Erstellung in Kampagnen für kleinere NGOs mit wenig Kapital.“

Allerdings könnten auch Ministerien mit ihren endlosen Abstimmungsschleifen profitieren. „Social-Media-Statements müssen vom Referenten zur Ministerin und zurück abgestimmt und im Zweifel noch aufgenommen werden. Das ginge schneller, wenn die KI einen Text im Sound der Ministerin schreibt und den abgesegneten Text in ihrer Stimme vorliest“, sagt Bölts.

Pressechef Rainer Grill ist da zurückhaltender. „Ich könnte kein Statement rausgeben, das mein Chef niemals gesagt hat“, sagt er. „Selbst wenn es zu ihm passen würde.“ Er erinnert sich heute an seine Zeit als Journalist. Damals tobte der Irakkrieg – und mit Photoshop konnte man den Krieg in die Bilder bringen. Das sei für ihn nie infrage gekommen.

Kommunikationsprofi Bölts glaubt, dass KI vor allem beim Ausspielen von Inhalten helfen kann. Sie wird Inhalte auf unterschiedliche Zielgruppen zuschneiden und dabei unterstützen, die Inhalte so auszuspielen, dass sie von den richtigen Personen gesehen werden. Das ist auch die Erwartung von Berlins Volt-Chefin Seeberg. „Derzeit muss man das Targeting immer wieder händisch nachjustieren“, sagt sie. „Mit KI werden wir Inhalte gezielter nach Gruppen filtern können. Das wird uns eine Menge Arbeit abnehmen.“

Der Faktor Mensch

An das Herzstück des Wahlkampfs möchte Seeberg aber keine Bots lassen. „Auf der Straße mit den Menschen zu reden, ist unheimlich wichtig für uns“, sagt sie. „Wir dürfen über mögliche KI-Anwendungen auf keinen Fall den Kontakt zu den Leuten verlieren. Das wäre fatal.“ Auch SPD-Politiker Wölken würde niemals KI-Tools einsetzen, um etwa eine Bürgeranfrage zu beantworten. „Wer fühlt sich denn mit seinen Sorgen und Wünschen wahrgenommen und respektiert, wenn einem eine KI statt ein Mensch antwortet?“, fragt er.

Eine KI kann unermüdlich menschenähnliche Texte schreiben und verteilen. Hier liegen Chancen, aber auch die größten Gefahren, da sind sich unsere Gesprächspartner einig. „Tools wie ChatGPT könnten zum Beispiel dazu eingesetzt werden, rasend schnell Propagandaartikel zu verfassen oder die Kommentarspalten von sozialen Netzwerken mit Desinformation zu fluten, die kaum bis gar nicht mehr von den Kommentaren echter Menschen zu unterscheiden wäre“, sagt SPD-Politiker Wölken.

Auch er hat im Brüsseler Europaparlament Anfang Februar eine KI-Rede gehalten. Bis zum Schluss habe niemand gemerkt, dass die Rede von einer KI geschrieben worden sei, sagt er. „Ich wollte darauf aufmerksam machen, wie gefährlich diese Tools ohne jede Regulierung sein können.“ Die KI-Rede war deshalb eine einmalige Sache. Wölken warnt: „Eine Entmenschlichung der politischen Kommunikation durch KI-Tools könnte verheerende Folgen für das Vertrauen der Menschen in die Politik haben.“

Christoph Neuberger, Professor für Kommunikationswissenschaft an der FU Berlin, denkt noch weiter: „Chatbots könnten am Ende die ganzen öffentliche Meinungsbildungsprozesse übernehmen und dafür parteipolitische Haltungen eingeimpft bekommen. Sie würden streiten, bis sie sich einigen oder völlig entzweien.“ Er warnt: „Das kann man weiterspinnen bis hin zur Stimmabgabe – das Ende wäre eine reine Demokratie-Simulation.“

Mit offenen Karten

Ein weiteres Problem ist, dass Chatbots sich keinen Begriff von wahr und falsch machen. Sie sind reine Vorhersagesysteme. Wenn man „Sehr geehrte“ übergibt, hängt der Bot „Damen und Herren“ dran. Bei wissenschaftlichen Literaturtipps kombiniert er gern häufige Vornamen mit häufigen Nachnamen und häufigen Buchtiteln zu Publikationen, die es gar nicht gibt. Fachleute nennen dieses Phänomen „Halluzinationen“ und raten, jede Ausgabe der KI genau zu überprüfen. „Erst mal enttäuschend“, sagt auch Analyst Schibberges, „aber vermutlich in ein bis zwei Jahren kein großes Thema mehr. Andere KI-Modelle sind hier auch schon weiter und liefern auf Nachfrage die Quellen mit, auf die sie ihre Aussagen basieren.“

Auch die Quellen müssen wir in den Blick nehmen, mahnt Bitkom-Referentin Uhl. „Wenn die KI eine Antwort gibt, dann wurde aus den vorhandenen Daten eine Auswahl vorgenommen“, sagt sie. „Auf welchen Kriterien diese Auswahl erfolgt, kann man zwar zum Teil steuern, aber nicht immer nachvollziehen.“ Hier liegt eine große Aufgabe für alle, die KI mit Daten trainieren. Transparenz ist das oberste Gebot.

Wenn das gelingt, hat Medienprofessor Neuberger für die politische Öffentlichkeit noch einen Traum: „Ein automatisiertes Moderationssystem für Diskussionen.“ Die Gesprächskultur im Netz kranke nicht allein daran, zu verrohen. Ein schlauer Chatbot als Moderator solle mehr tun, als einfach nur Hatespeech löschen. „Eine KI könnte schlaue Beiträge, die klug argumentieren, stärker gewichten. Sie könnte Behauptungen nachprüfen, Statistiken und Fakten einbringen und den Stand der Diskussion zusammenfassen“, sagt Neuberger. „Und sie könnte das über Blasen hinweg und bei Tausenden Beiträgen. Ein Mensch kann das niemals leisten.“

Dieser Beitrag erschien zuerst in der gedruckten Ausgabe N° 142 – Thema: Künstliche Intelligenz. Das Heft können Sie hier bestellen.